Giải pháp Trí thông minh nhân tạo Việt Nam (VAIS), chuyên gia về ứng dụng công nghệ AI của người Việt cho biết, không gian mạng hiện nay không chỉ là công cụ phân phối tin tức mà đã trở thành một chiến trường thông tin thực sự.

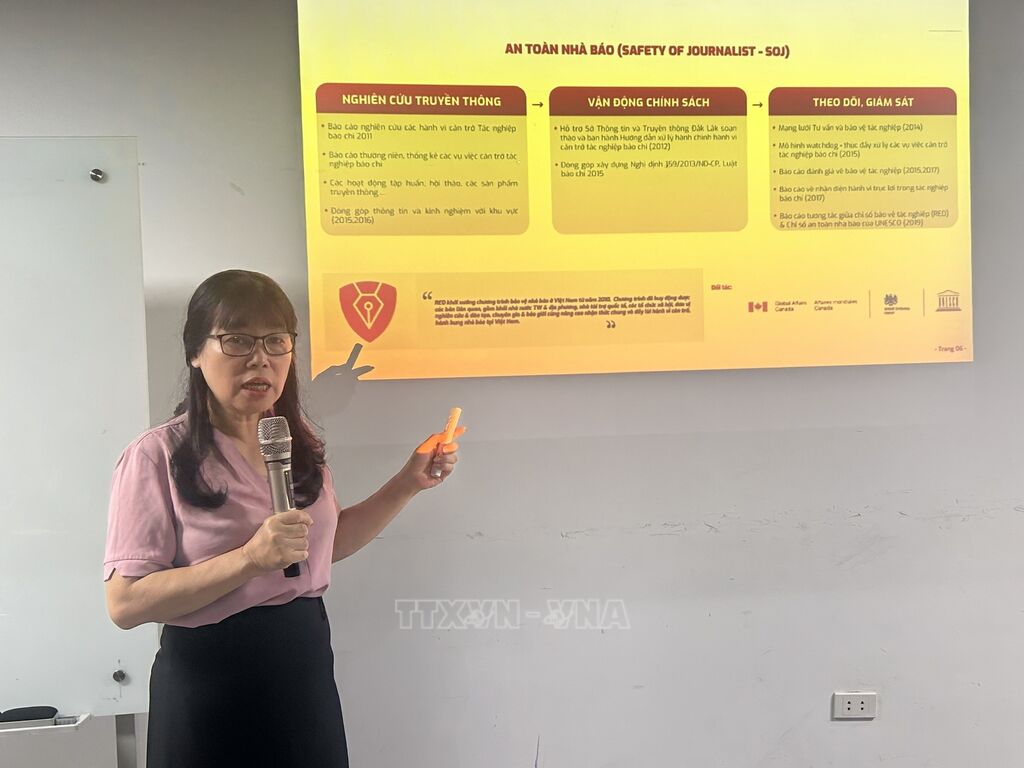

Nằm trong chuỗi hoạt động chuyên đề "An toàn tác nghiệp của nhà báo và thách thức trong thời công nghệ số", ngày 16/5, tại Hà Nội, Viện Nghiên cứu Truyền thông phát triển (Liên hiệp các Hội Khoa học và Kỹ thuật Việt Nam) tổ chức tọa đàm “AI trong tác nghiệp báo chí”.

Khai mạc tọa đàm, bà Trần Thị Khánh Hòa, Phó Viện trưởng Viện Nghiên cứu Truyền thông phát triển (RED) cho biết, trong bối cảnh chuyển đổi số diễn ra mạnh mẽ, việc làm chủ công nghệ không chỉ giúp các tòa soạn tối ưu nguồn lực mà còn hỗ trợ phóng viên, biên tập viên thích ứng với phương thức làm truyền thông hiện đại. Do đó, mục đích của tọa đàm nhằm chia sẻ kiến thức và kỹ năng liên quan đến an toàn tác nghiệp báo chí, giúp nhà báo khai thác, xác minh, sử dụng thông tin an toàn, hợp pháp, minh bạch và có trách nhiệm trong môi trường số và AI.

Chia sẻ tại chương trình, ông Phạm Tấn Anh Vũ, Trưởng đại diện khu vực phía Nam, Công ty Cổ phần Giải pháp Trí thông minh nhân tạo Việt Nam (VAIS), chuyên gia về ứng dụng công nghệ AI của người Việt cho biết, không gian mạng hiện nay không chỉ là công cụ phân phối tin tức mà đã trở thành một chiến trường thông tin thực sự. Sự kết hợp giữa trí tuệ nhân tạo tạo sinh (Generative AI) và tội phạm mạng tạo ra các rủi ro mang tính hủy diệt như: Tấn công phi kỹ thuật (Social Engineering), mã độc tống tiền (Ransomware), công nghệ giả mạo siêu thực (Deepfake)...

Nhấn mạnh rủi ro an toàn theo giới tính, ông Phạm Tấn Anh Vũ cho rằng, mọi nhà báo đều có nguy cơ bị tổng hợp danh tính giả, bị ghép ảnh, ghép giọng nói, tạo video vi phạm để hủy hoại sự nghiệp; tấn công tài khoản mạng xã hội có lượng theo dõi lớn để phát tin giả mạo danh; nhằm vào người thân qua mạng xã hội để gây áp lực, buộc dừng điều tra. Nhất là với nhà báo nữ, kẻ tấn công dùng bão ngôn từ bình luận về ngoại hình để ép họ chuyển qua tâm lý tự ti và rút lui khỏi không gian công cộng…

Để hạn chế rủi ro bị tấn công, ông Phạm Tấn Anh Vũ đề nghị, nhà báo cần có một tư duy phòng thủ hoàn toàn mới; tìm hiểu kỹ về Hệ sinh thái pháp lý mới như: Luật An ninh mạng, Luật Bảo vệ dữ liệu cá nhân 2026, Luật Trí tuệ nhân tạo (AI) 2025 và Bộ luật Hình sự sửa đổi 2025… nhằm nhận diện rõ bối cảnh rủi ro xung quanh.

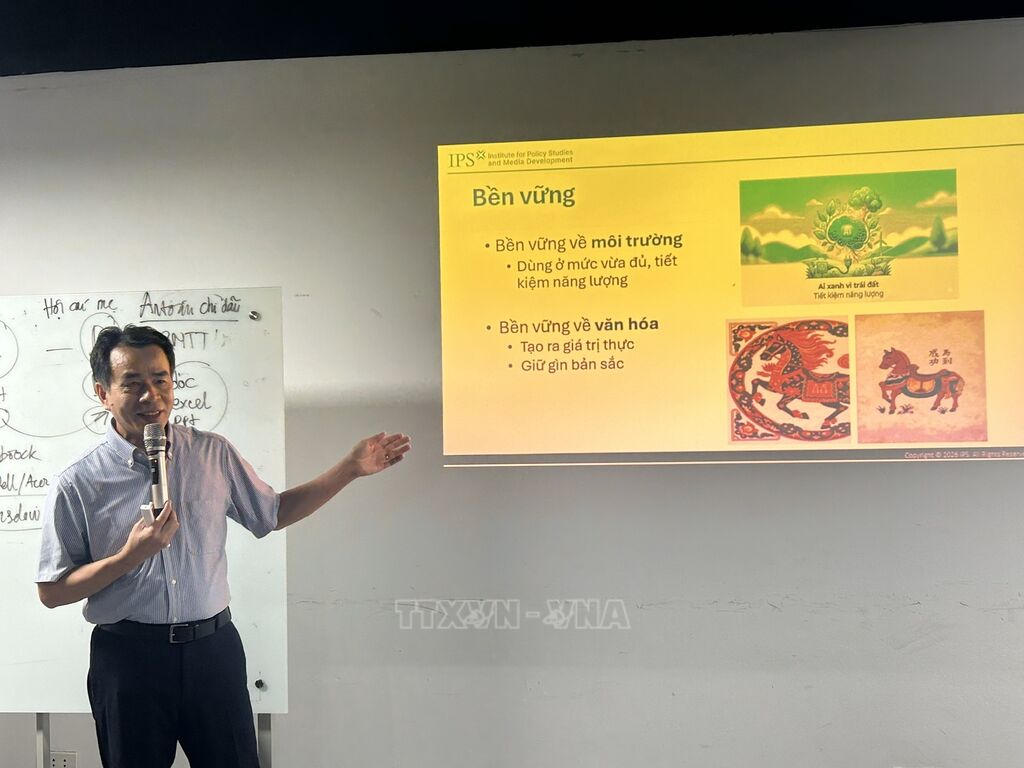

Đánh giá sử dụng AI có trách nhiệm trong truyền thông, ông Nguyễn Đức Lam, Viện Nghiên cứu chính sách và phát triển truyền thông (Hội Truyền thông số) cho rằng, hiện thế giới có các công cụ điều chỉnh hành vi liên quan đến AI như: các quy tắc đạo đức và quy tắc ứng xử, hướng dẫn và tiêu chuẩn kỹ thuật, luật và quy định… Tại Việt Nam, song song với việc ban hành các quy định pháp lý “cứng” mang tính bắt buộc, Chính phủ khuyến khích việc xây dựng và phổ biến các bộ quy tắc ứng xử về AI, trong đó có Bộ quy tắc sử dụng AI có trách nhiệm trong truyền thông số. Nếu pháp lý đóng vai trò “khung” bắt buộc, các bộ quy tắc sẽ mang tính đồng thuận, tự nguyện, hỗ trợ tổ chức và cá nhân thực hành đúng chuẩn mực trong công việc hàng ngày.

Ông Nguyễn Đức Lam nhấn mạnh, Bộ quy tắc này gồm 8 nguyên tắc cốt lõi: Tôn trọng phẩm giá con người; con người chịu trách nhiệm cuối cùng; phát triển bền vững; công bằng, chống phân biệt đối xử; minh bạch; đáng tin cậy; bảo vệ dữ liệu cá nhân; tôn trọng quyền sở hữu trí tuệ. Trên cơ sở này, Bộ quy tắc đưa ra 29 hướng dẫn cụ thể cho người dùng AI và 5 lưu ý riêng đối với quảng cáo trực tuyến, nhằm giúp ứng dụng AI vừa sáng tạo, vừa phù hợp pháp luật và chuẩn mực đạo đức.

Tại tọa đàm, các chuyên gia đã thảo luận một số nội dung khác như: Nhận thức rủi ro và lằn ranh pháp lý; kỹ năng phòng vệ cốt lõi; trí tuệ nhân tạo: Phát hiện và xác minh; khôi phục và dùng Luật làm lá chắn... Từ đó, các chuyên gia đề xuất một số giải pháp chiến lược nhằm định hình tư duy và bảo vệ đội ngũ làm báo trước làn sóng công nghệ; đặc biệt nhấn mạnh tầm quan trọng cốt lõi của việc nâng cao nhận thức và trách nhiệm của nhà báo khi sử dụng AI trong tác nghiệp./.